DJI et Intel : Movidius Myriad 2

Quel est le point commun entre la plupart des drones « selfies », comme le Dobby de Zerotech, l’Alpha Cam de Sunly ou le Hover Passport Camera de Zero Zero Robotics ? Non, « ils sont chers et sans intérêt » n’est pas la bonne réponse. Le point commun, c’est que leur électronique repose sur la solution Snapdragon de Qualcomm. En face de Qualcomm, il y a le géant Intel. Il s’est investi dans les drones depuis plusieurs années, notamment via Ascend Technologies et Yuneec (voir ici). Mais saviez-vous qu’il équipe aussi le leader des drones, le constructeur chinois DJI ?

Quel est le point commun entre la plupart des drones « selfies », comme le Dobby de Zerotech, l’Alpha Cam de Sunly ou le Hover Passport Camera de Zero Zero Robotics ? Non, « ils sont chers et sans intérêt » n’est pas la bonne réponse. Le point commun, c’est que leur électronique repose sur la solution Snapdragon de Qualcomm. En face de Qualcomm, il y a le géant Intel. Il s’est investi dans les drones depuis plusieurs années, notamment via Ascend Technologies et Yuneec (voir ici). Mais saviez-vous qu’il équipe aussi le leader des drones, le constructeur chinois DJI ?

Intel au coeur du Spark de DJI !

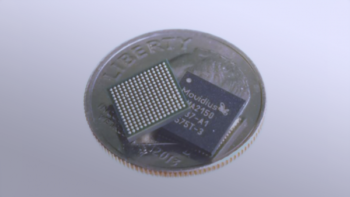

La petite caméra volante de DJI est équipée d’outils de captation de son environnement. C’est ce qui lui permet d’être piloté avec des gestes, de se fixer sur une forme pendant le vol pour la filmer et de détecter les obstacles.  Pour traiter ces informations, le Spark est équipé d’un processeur puissant capable de s’occuper des calculs en temps réel. Il s’agit d’une « Vision Processing Unit » (VPU), autrement dit un processeur entièrement dédié au traitement des informations en provenance de la caméra principale, de la caméra verticale, des capteurs infrarouges.

Pour traiter ces informations, le Spark est équipé d’un processeur puissant capable de s’occuper des calculs en temps réel. Il s’agit d’une « Vision Processing Unit » (VPU), autrement dit un processeur entièrement dédié au traitement des informations en provenance de la caméra principale, de la caméra verticale, des capteurs infrarouges.

Son nom ?

C’est le Myriad 2, commercialisé par Movidius, une société appartenant à Intel. A sa tête, on trouve Rémi El-Ouzzane, un français formé à Grenoble, ancien de Texas Instruments. Entré chez Movidius en 2013, il s’est occupé du lancement du Myriad 2 en 2014, puis a réalisé des partenariats avec DJI, mais aussi Google, Lenovo et FLIR. Intel a acquis Movidius en novembre 2016. Parmi les particularités de Myriad 2, on note qu’il pratique le Deep Learning, avec des fonctions d’apprentissage automatique pour modéliser les données acquises par les capteurs à bord du Spark. Et pas uniquement ! Car la puce Myriad 2 équipe aussi le Phantom 4 (Myriad MA2100), le Phantom 4 Pro et le Mavic Pro (Myriad MA2155)…

C’est le Myriad 2, commercialisé par Movidius, une société appartenant à Intel. A sa tête, on trouve Rémi El-Ouzzane, un français formé à Grenoble, ancien de Texas Instruments. Entré chez Movidius en 2013, il s’est occupé du lancement du Myriad 2 en 2014, puis a réalisé des partenariats avec DJI, mais aussi Google, Lenovo et FLIR. Intel a acquis Movidius en novembre 2016. Parmi les particularités de Myriad 2, on note qu’il pratique le Deep Learning, avec des fonctions d’apprentissage automatique pour modéliser les données acquises par les capteurs à bord du Spark. Et pas uniquement ! Car la puce Myriad 2 équipe aussi le Phantom 4 (Myriad MA2100), le Phantom 4 Pro et le Mavic Pro (Myriad MA2155)…

Le site officiel de Movidius se trouve ici.

https://youtu.be/hX0UELNRR1I

@Fred …. Je vais faire mon chieur mais je ne crois pas que le système puisse « fine tuner » un modèle deep en temps réel…. En effet, en supposant même une topologie deep relativement « light » genre Alexnet, une seule itération de de fine-tuning/transfert Learning te « plierait » la machine… Même avec des archis standards, un fine-tuning ca représente au minimum des dizaines de minutes avec des clusters de GPU et des heures avec des archis CPU. Ce qu’il faut plutôt comprendre, c’est qu’en fonction des données capteurs reçues et d’un modèle préalablement pré-entrainé, le VPU est capable de prédire/diagnostiquer l’état du sol …

@ SeByDocKy : Bah c’est comme d’habitude, tu as le Deep learning marketing, la version universitaire de labo et la version opérationnelle. Ca fait 3 choses différentes qui se recoupent. Là, on est dans la version marketing…

Haha, excellente analyse @Fred !

Et chouette article.

A+

En même temps, si on peut compter sur 100 gigaflops ça permet déjà de commencer à bricoler, non ?

D’après ceci : http://www.silicon.fr/intel-cle-usb-deep-learning-180943.html

Un petit saprk 2 avec ocusync et du intel, et je dis bingo ^^